日本政策金融公庫より1億円の資金調達を実施しました

株式会社AiCANは、日本政策金融公庫から1億円の新株予約権付融資を受けたことをお知らせいたします。今回の調達により、融資を含む累計資金調達額は約7億円となりました。

当社が提供する「AiCANサービス」は、現在16の自治体に導入され、ユーザー数は1,000名を超えております。さらに、実証実験を通じて、地域や規模の異なる自治体においても「AiCANサービス」が有効に機能する可能性があることを確認しました。こうした結果を踏まえ、今後は導入地域のさらなる拡大を進めてまいります。

今回調達した資金を元に、より多くのユーザーにご利用いただけるよう採用を拡大して開発体制・営業体制の強化を行い、既存サービスの改善を進めるとともに、関係機関や近接領域を対象としたサービスへと展開してまいります。

プレスリリース

2025年7月29日 PR TIMES 記事

児童虐待の解決を目指すAiCAN、日本政策金融公庫より1億円の資金調達を実施

2025年7月29日、HIRAC FUND 公式noteに当社代表・髙岡及び当社CMO・橋本のインタビューが掲載されました。

本記事では、当社のカスタマーサクセス職の特長や、AiCANサービスの導入による効果、今後の展望などについて語っています。

ぜひ、下記のリンクから詳細をご覧ください。

「すべての子どもたちが安全な世界」を目指すAiCANの挑戦!〜インパクトスタートアップで現場に伴走するCS(カスタマーサクセス)を紹介〜|HIRAC FUND 公式note

品質の高いAIを開発し、それを活用して価値を生み出していくためには、さまざまな努力が求められます。例えば、ユーザーと協働した開発や、継続的な品質の管理、公平性などの倫理的な視点からの評価。子ども虐待対応という領域でサービスを提供するAiCAN社は、どのようなスタンスでAI開発に取り組んでいるのでしょうか。代表・髙岡に話を聞きました。

髙岡昂太/Kota Takaoka

教育学博士、臨床心理士、公認心理師、司法面接士。

児童相談所や医療機関、司法機関において、15年間、虐待や性暴力などに対する臨床に携わっている。

2011年千葉大学子どものこころの発達研究センター特任助教、学術振興会特別研究員PD、海外特別研究員(ブリティッシュコロンビア大学)を経て、2017年より産業技術総合研究所人工知能研究センター所属、主任研究員。2020年3月に株式会社AiCANを立ち上げ、2022年4月から同社CEOに就任。

ーー今日のテーマは「真に価値を生み出すAI活用の在り方」。髙岡代表は、以前登壇したシンポジウムでも話していたように、かねてより「AIは魔法の杖ではない」と警鐘を鳴らしていますよね。

児童福祉現場の深刻な人手不足と過大な業務負担を受けて、業務効率化のためにAIを導入する動きが、近年、急速に進んでいます。また、単純に職員の数が足りないだけでなく、2020年に勤続3年未満の児童福祉司が全体の半数を超える(※1)など、新人を育てるベテランの数が不足している状況下で、「人材育成」の観点でもAIへの期待が高まっています。

※1:厚生労働省 全国児童福祉主管課長・児童相談所長会議資料

令和2(2020)年度 児童相談所関連データ p13「児童福祉司・児童心理司の勤務年数」

児童福祉の現場が直面する課題が注目されることや、さまざまなソリューションが生み出されること自体はとても喜ばしいことです。その一方で、開発・導入が性急に進められているケースも少なくないのではないかと懸念しています。AIを活用したことで子どもの安全が危ぶまれるようではいけないし、作り方や使い方の問題で「やっぱりAIって役に立たないね」と思われてしまうのも、非常にもったいない。

もちろん、「AIも、使い方を誤れば毒にもなりうる」というのは、子ども虐待対応の現場へAI搭載アプリを提供している当社も抱えているリスクです。大切なのは「本当に現場にとって役立つ、子どもの安全に資するAI」を開発し、適切に活用してもらうこと。児童福祉の課題解決に取り組む者として、同じ立場の皆様とは、そういった前提や知見を共有していきたい。「AIは万能ではない」というのは、世間にも浸透してほしいなと思います。

どんなに良い薬にも、必ず副作用がある

ーー「使い方を誤れば毒にもなりうる」というのは、どのような意味でしょう?

薬に例えるとわかりやすいかもしれません。違法なものもあれば、医薬品もある。きちんと基準を満たし、効果も安全性も認められた医薬品にも、必ず副作用があって、用法・用量を守らなければ危険につながります。当社のデータサイエンティストは、よく、自動車を例に挙げています。すごく便利な移動手段だけど、人の命を奪うこともある。

問題は、現在のAI開発において統一的な安全基準が確立されていないこと、そして、そもそも「AIの危険性」に目が向けられていないことです。例えば自動車なら、交通事故の多さが啓蒙されていますが、AIに関しては、急速な技術の発展もあって「こんなことができてすごい!」という便利さばかり注目されているように感じます。

AIが判断を下すわけではなく、意思決定の主体は人間です。ハンドルを握って車を運転するのが人間であるように、AIを使うのもまた人間です。我々作り手が適切なAIを開発することはもちろん、使い手にも正しい知識が必要です。

ーーなるほど。「AIの危険性に目が向けられていない」とのことでしたが、具体的に、どのようなリスクがあるのでしょうか?

まず、AIはそれほど万能な存在ではありません。あくまでも、事前に与えられているデータ、事前に学習している情報からしか出力できません。わかりやすく言うと「このAIは10種類の情報についてデータを与えられているけれど、人間は11種類目の情報を重要視している」ような場合、「AIの結果はこうだけど、わたしたちの感覚と違うぞ…?」と違和感を覚えることもあります。

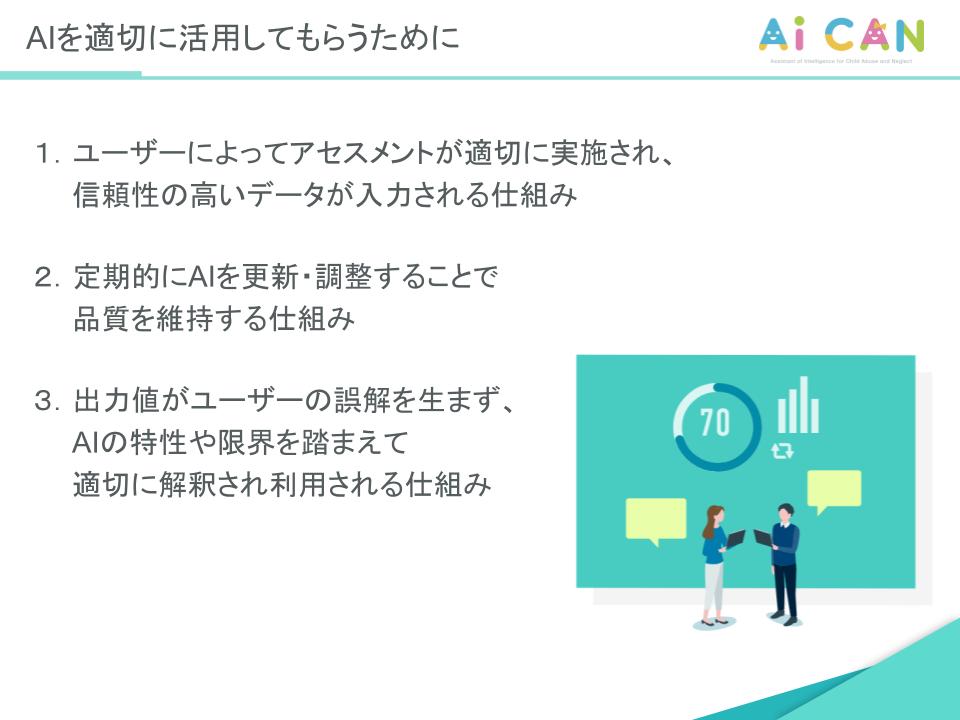

今お話した例は、AI開発において重要な観点の一つである「どのようなデータがどれだけ与えられているか」ですが、AiCAN社では、適切にAIを活用してもらうために以下の3つの仕組みが確保されることが大切だと考えています。

まず、1つ目について。例えば、「子どもが家に帰りたくないと言っている」というアセスメント項目(注:子どもや家庭の状態を評価するためのチェック項目)があったとして、同じ場面を見ていても、チェックをつける人・つけない人とばらつきが出ることがあります。「お家に帰る?」と尋ねても黙っている子どもを見たとき、ベテラン職員は「よく見ると手が震えているし、きっと家に帰るのは怖いんだろう」と思っても、新人は「帰りたくないとは言わないから、大丈夫かな」と思ってしまったり。

このような場合、「ユーザーによってアセスメントが適切に実施」されているとは言い切れません。当社の提供するAiCANアプリの場合、職員の方々が子どもや家庭の調査を進める中で、こういったアセスメント項目を入力してもらい、そこで蓄積されたデータからAIが作られることになります。より正しい示唆を導くAIを開発するには、そもそも信頼性の高いデータを集める必要があるので、アプリの使い方以前に、ユーザー様へ「アセスメント研修」を行っています。

また、AIの予測精度を維持するには、開発するとき・その一度きりだけデータを集めるというわけではなく、定期的にデータを与えていくことが重要です。これが、2つ目の「定期的にAIを更新する」こと。ここでいう「更新」は、変化していく状況に合わせて、学習させるデータを選別したり、適切な結果を出すためにモデルの調整を行なったりすることを指します。

例えば、子ども虐待の対応件数は年々増えているのに、保護所の定員が変わらないといった理由で、一時保護が行われた件数も一定の場合、毎年保護率が下がっていくのは当然です。それを「毎年保護率が下がっているから、保護が必要な重篤ケースは減っているんだな」と捉えてしまったらおかしなことになりますよね。間違った解釈をしないよう、そういった背景情報を含む「量と質の担保されたデータ」を蓄積していかないと、適切な結果を出力できるAIは作れません。

そして3つ目に、AIの出力結果を適切に活用してもらうことが大切です。例えば「再虐待通告が発生する確率が5%」といった結果が出たとき、出力結果が意味するのは言葉の通りなのですが、「総合的な危険性も低い」という印象や誤った解釈を与えてしまうことがあるかもしれません。

AiCANサービスでは、AIが出力する複数の指標について、その意味や解釈の仕方をユーザー様へレクチャーする研修会を行っています。また、定期的にワーキンググループを開催し、ユーザー様からもさまざまな意見や疑問点を共有してもらうなど、AIの作り手・使い手が二人三脚となって、よりよい活用の在り方を探っています。

過去から学ぶ手段として、AIがある

ーー薬も、どんな病気にも効く万能薬はないですしね。病気や症状に合わせたさまざまな薬があるし、服用する人によって用量も異なります。

そうです。AIといっても、なんのために開発されたAIなのかであったり、その裏側で動いている技術もさまざま。「薬を作りたい」というより「この病気や症状を治したい」から薬が開発されるように、僕らも「子どもの安全」を実現するソリューションとして、AIを開発しているに過ぎません。

我々が解析しているデータは、これまで職員の方々が対応してきた子ども虐待事例の蓄積であって、いわば人間の経験値です。そこから導き出されるAIの出力結果というのは、先人たちのアドバイスのようなもの。

子ども虐待対応に限りませんが「これさえすれば大丈夫!」みたいな絶対の法則はないので、過去のさまざまな事例から学び続けることで、同じ失敗を繰り返さないことが大事。その学びの手段として、AI技術がある。今後もっといい手段が見つかったら、必ずしもAIじゃなくてもいい。未来の子どもたちへ活かすために、これまでの経験を皆で共有し、学び合い、知見を引き継いでいけたらいいなと思っています。

ーーなるほど、先輩から後輩へと受け継がれていくような…。冒頭でも、人材育成が追いついていないというお話がありましたよね。

はい。非常に専門性の高い仕事なのに、教育研修の機会も十分に取れていないのが現状です。子ども虐待対応は本当に難しくて、保護者が「これは転んだ怪我」と言っていても嘘かもしれないし、支援に拒否的であったり攻撃的な保護者とも対峙しなければいけない。そして短い時間の中で、子どもの命に関わる重大な判断を迫られる。

そんな現場で奮闘してきた職員の方々の知見を、仕組み化するお手伝いをしたいんです。ベテランの暗黙知を、新人にもわかるような形式知へと可視化していきたい。「チェックリストの中に明示されていなかったけど、実は職員の方々はこんな観点を見ている」ことがわかったら、新たにアセスメント項目として組み入れて、データを溜めていくことができる。そこから、またAIがアップデートされていく。

これは、AIやアプリを導入したら解決!という簡単な話ではなくて。我々がやろうとしているのは、とても地道で泥臭い作業です。まずは現場の業務に寄り添って、どんなことをやっているのか丁寧に紐解いていく。現場の方々が培ってきたノウハウを言語化して、未来へ引き継いでいくプロセスに伴走することで、一緒に「子どもが安全な世界」を目指したい。だから、僕らのサービスは「伴走型業務支援」なんです。

当社のデータサイエンティストが口にしているのは「なんのためにAIを利用するのか。誰の幸せを願ってつくるのか」。農家の方が土壌作りからこだわるように、我々も開発の基盤を整備するところから、実際にシステムを利用するユーザーや、最終受益者である子どもに至るまで、全体と本質を捉えて開発と実践を進めていきたい。それがガバナンス、「責任あるAIを実践する」ということにつながるのだと思います。今後も、誠実に開発を進めていくと同時に、適切にAIを活用していただけるように、ユーザーの皆様を全力でサポートしてまいります。

(取材・文/Akane Matsumura)

2022年8月28日に、東京大学バリアフリー教育開発研究センターが主催したシンポジウム『虐待と向き合う児童相談所の新たな役割と可能性』に弊社代表・髙岡が登壇しました。

本シンポジウムは、日曜日の朝9:00スタート・3時間という長丁場にもかかわらず、なんと1000人超の参加申込をいただき、非常に大盛況のオンラインイベントとなりました!児童相談所をはじめとした、子どもや福祉に関わるお仕事をしている方はもちろん、東京大学主催ということもあり、学生の方にも多くご参加いただいたようです。本日は、広報担当・松村がその模様をレポートいたします。

・・・

子どもが輝く未来のために、奮闘する人たち

今、児童相談所は危機的な状況に陥っており、増え続ける虐待件数にマンパワーが追いついていません。単純な件数の増加だけでなく、DVなど様々な要因により対応が複雑化している上、発達支援など子育て相談ニーズも増大・多様化しています。現場の業務負担は深刻化しており、需要が高まる一方で、離職者が後を絶ちません。

そんな児童相談所を応援する企画として立ち上げられたのが、今回のシンポジウムです。本企画の火付け役となった、東京大学産学協創フォーラム「臨床心理iNEXT」は、「行政の限界を超えて、新たな児童相談サービスの展開を議論する」と宣言しています。

シンポジウムの登壇者は、児童相談所や児童心理治療施設といった子どもたちと向き合う現場の人たちから、臨床心理・子ども虐待・データによる政策評価などを専門とする研究者たちまで、多彩な顔ぶれです。「地域において子どもの安全を守り、子育て支援の環境を整備する」をテーマに、さまざまな視点から「子どもたちの輝く未来のために」奮闘する人たちが集結しました!

子ども虐待とデータサイエンス

児童相談所が直面する課題や今後の展望について、最新の動向やデータを紹介しながら、登壇者たちが議論を交わしました。2022年6月に成立したばかりの改正児童福祉法では、裁判官が一時保護の必要性を判断する“司法審査”が導入され、附帯決議では、支援事業等の取り組みについて科学的な効果検証について言及されるなど、児童福祉における「データサイエンス」の需要が高まっています。

さまざまな分野の登壇者から、「基礎自治体が持つ膨大なデータを、ケースワークや子育て支援にどう活かしていくのかが、今後の課題」「通告初期の調査項目が統一されていない現状では、客観的かつ妥当性の高いデータ検証ができない」といった指摘がなされたり、「市の子育て支援課と関係機関が情報共有できるシステムの導入事例がある」など、先進的な取り組みが紹介されました。

弊社代表の髙岡からも「児童虐待対応におけるDXとデータ利活⽤」をテーマにお話いたしました。高岡は、臨床心理士として、児童相談所や医療機関・司法機関などの現場で、15年以上、虐待や性暴力に対する臨床に携わってきました。また、産総研 人工知能研究センターで、子ども虐待や発達障害、社会的孤立などの社会課題に取り組んできた研究者でもあります。現場の経験知や専門性と、データやテクノロジーの力を合わせることで、課題解決を目指してきた立場から提案する「児童福祉×データサイエンスの可能性」。スライド全33ページのうち、一部内容をピックアップしてお届けします。

▼代表・高岡のプロフィールはこちら▼

https://www.wantedly.com/id/kota_takaoka_aican

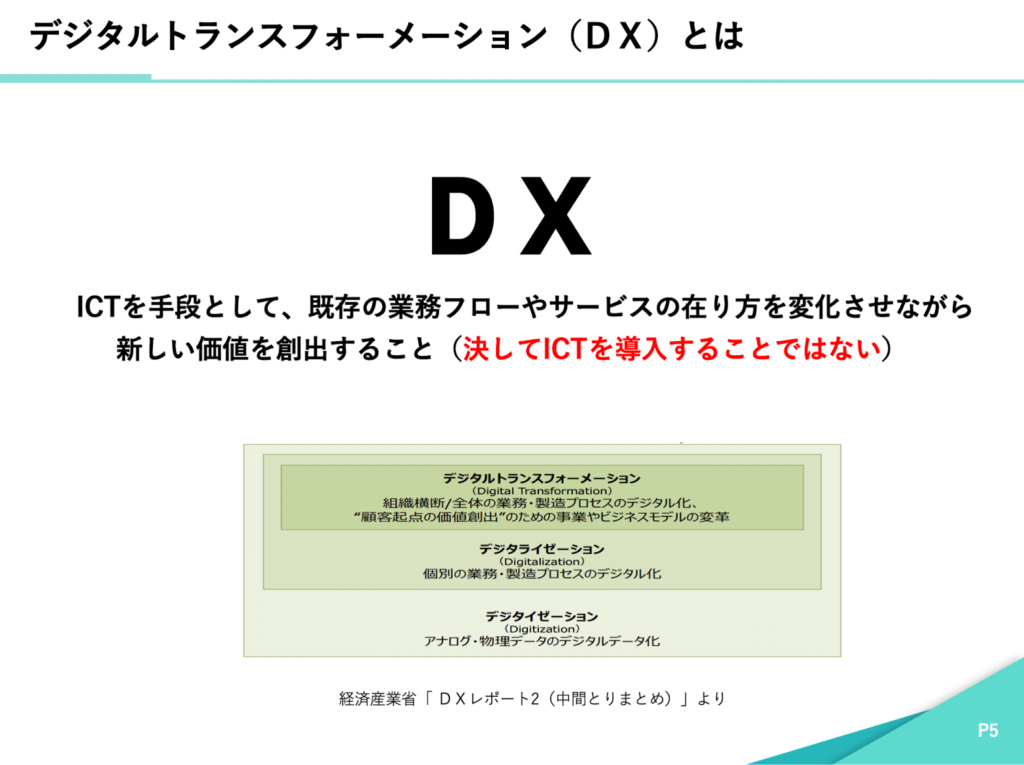

DX=ICT化ではない

昨今、コロナ禍におけるリモートワーク需要の高まりもあり「デジタル化・DX推進」というフレーズをよく耳にしますが、ICTツールを導入することがDXであるかのように語られがちです。しかし、ICT化はDXの手段であって、目指す姿そのものではありません。「既存のフローや業務のあり方を変化させ、新しい価値をつくる」ことがDX=デジタルトランスフォーメーションなのです。

DXには3段階あるとされています。第1段階はデジタイゼーション、アナログで管理されていたデータを、デジタル化すること。これまで紙へ記入していた調査記録を、Excelやアプリにするといった例が考えられます。第2段階・デジタライゼーションは、業務“プロセス”のデジタル化。児童相談所なら、通告を受けてから終結するまでの全てをデジタルデータとして蓄積していきます。そして第3段階・デジタルトランスフォーメーションでは、データを解析・利活用し、本来あるべき業務のあり方へ変革させていく。

DXを推進するには、解決したい課題の確認からはじまり、目指すべき理想の業務のあり方を詳細に整理し、数年単位での効果指標の設定など、入念な準備・計画が重要です。実際のツール導入にあたっては、現場への丁寧な説明と動機づけも欠かせません。運用していく中で、再度課題を洗い出し、「あるべき業務の形」を目指して、仮説検証を重ねていきます。あらかじめ完成形を描いて開始することは難しく、成功例だけでなく失敗例からも学びながら、改善のサイクルを回していくことが大切です。

AIは“魔法の杖”ではない

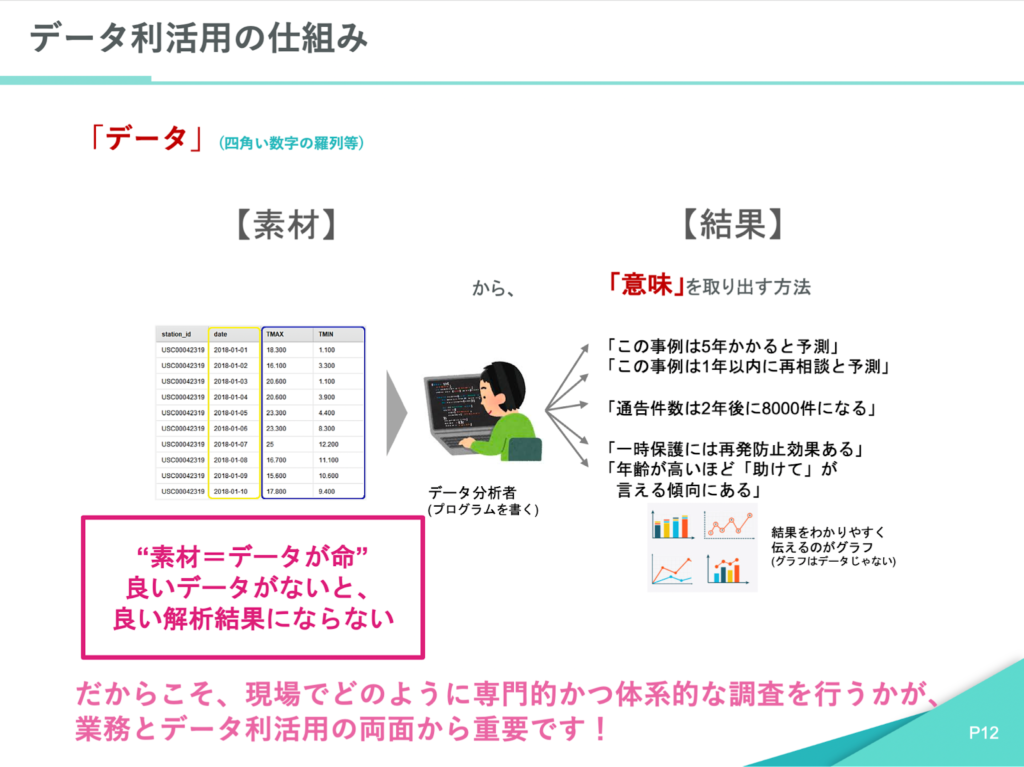

データ解析とは、数字やテキストの羅列といった「データ」という素材から、「意味」を取り出すことです。例えば子ども虐待のデータであれば、「通告件数は2年後に8000件になるだろう」「子どもの年齢が高いほど、助けを求められる傾向にある」といった「意味」を得ることができます。

ただし、よいデータがないと、よい解析結果は得られません。料理と同じく素材が命で、データが不十分だと、解析しても知りたいことがわからない場合もあります。データを業務に活用するためには、データを集める段階、つまりどのように専門的かつ体系的な調査を行うかが重要となります。

また、データ利活用には、得意なこと・苦手なことがあります。予測・判定・識別など、いわゆるビッグデータ・大量のデータから複雑なパターンを見出すことは得意ですが、発生頻度が非常に低い事象について高い精度で予測・判定をすることは苦手です。データは診断や判断などの「結論」にはなりません。あくまで参照するものであり、特に子ども虐待対応のような対人援助の領域では、最終的な判断決定は、常に人が行います。

これまで発生したことのない事象や、データを持っていない事象(そもそも調査していない項目など)については、予測や判定をすることはできません。「テキストデータがたくさん溜まってるから、AIに使えるよね?」と言われることがありますが、データがあるからといって、必ずしも「意味」を取り出すことができるとは限りません。AIを含むデータ利活用は「魔法の杖」ではないのです。

データはバイアスを調整するバランサー

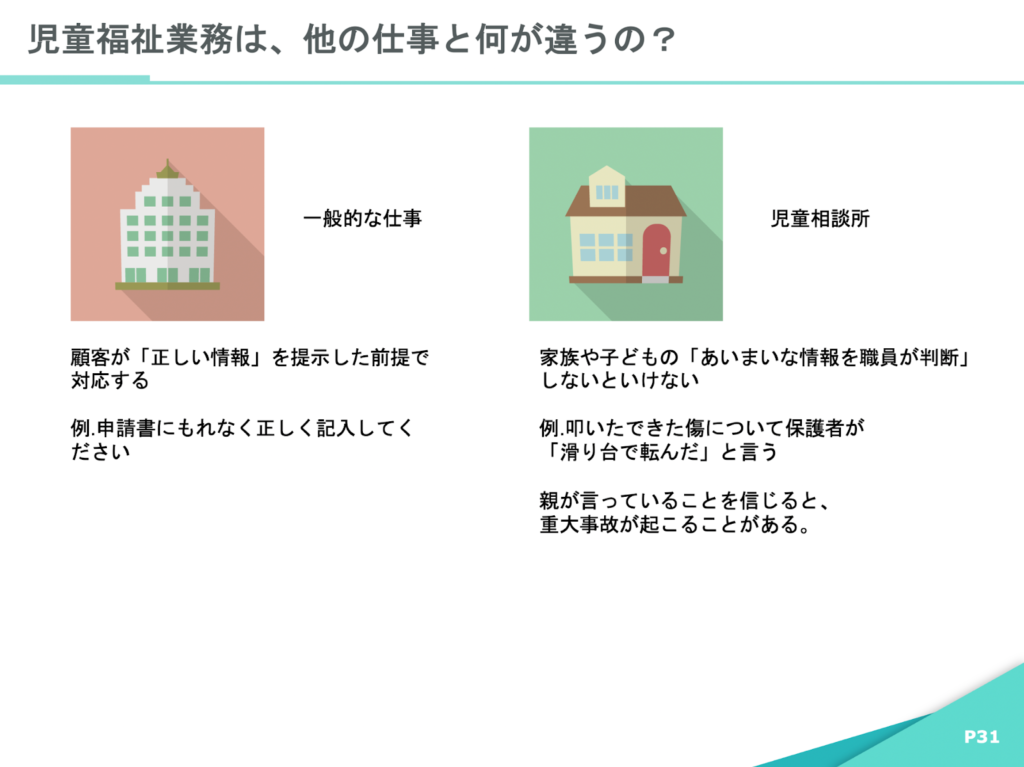

児童福祉領域だからこそデータが役立つのには、その業務の特性に理由があります。例えば「お客様が記入した申請書にもとづいて手続きする」など、一般的な仕事では、基本的に「顧客が正しい情報を提示した前提」で対応します。一方、児童相談所の場合、「本当は叩いたときの傷なのに、親が『滑り台で転んだ』と話した」場合、親の言葉を信じると、取り返しのつかない事態になることもあります。得られる情報が正しいとは限らず、「あいまいな情報を職員が判断」しないといけません。

このような状況では、バイアスがかかりやすくなっています。バイアスとは、「このケースならたぶん大丈夫だろう」「経験上、こっちよりあっちのケースのほうが危ないだろう」といった、偏った考え方になること。虐待死亡事例は、バイアスが原因となっているケースが多いと言われています。感情、経験、強いストレス環境や業務環境によってバイアスが働くほか、そもそも人間は、判断に迷うと「大丈夫だろう」という正常性バイアスが働く性質を持っています。

そんなとき、冷静にバイアスを調整するバランサーとして、データを参照してもらいたいのです。「自分はこう考えたけど…過去のデータを見ても同じだ!」とわかれば、背中を押してもらえる。「あれ、こうだと思っていたけど、データを見ると違うかも?」となれば、少し立ち止まって、見落としがないか振り返ることができる。意思決定を行うのは人間ですが、データは、現場で働くみなさんの経験や感覚を裏付け、専門性を底上げしてくれる武器になると考えています。

ウェルビーイングの土台は「健康・安全」

昨今、ファッション誌などでも取り上げられるほど、耳にすることの多い「ウェルビーイング(Well-being)」。個人の権利や自己実現が保障され、身体的、精神的、社会的に良好な状態にあることを意味する概念です。感情的・瞬間的な「Happiness」ではなく「持続する幸せ」として、SDGs(持続可能な開発目標)と共に語られることも多い言葉です。

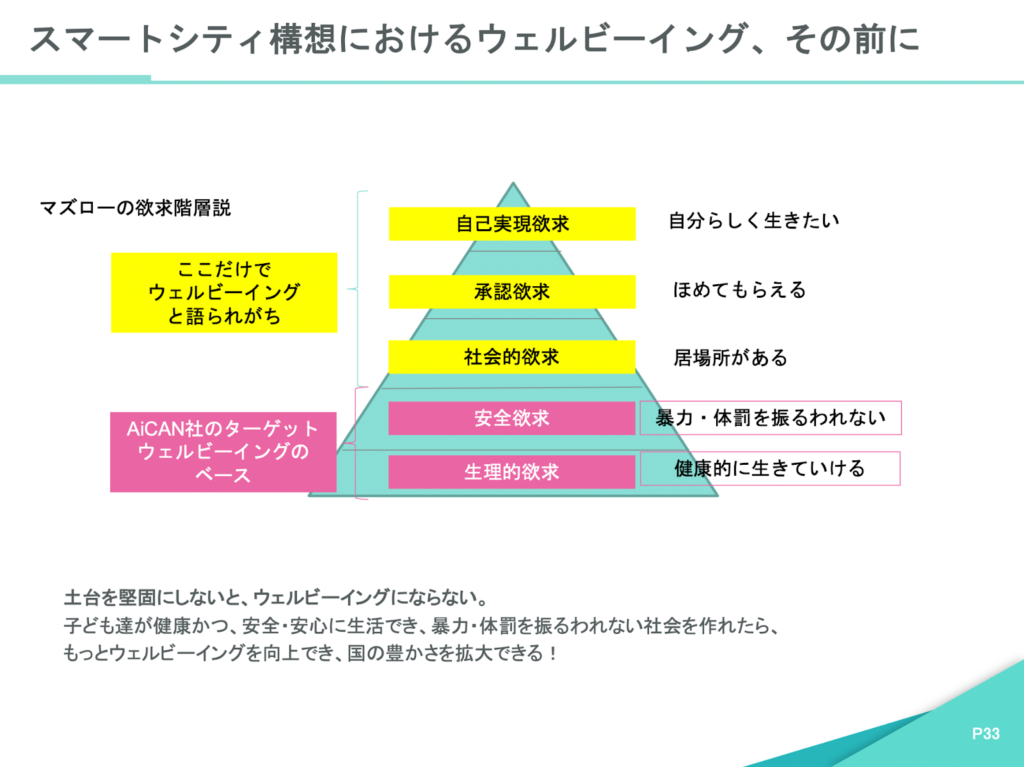

「幸福」「ウェルビーイング」について考える上で、マズローの欲求階層説を取り上げさせてください。人間は、まず、生きていくために必要不可欠な食事や睡眠を求める「生理的欲求」を満たそうとし、それが満たされたら「安全欲求」「社会的欲求」…と段階的に次の欲求を求めようとする、という考え方です。

「ウェルビーイング」という言葉が使われるとき、社会的欲求や自己実現欲求といった、この階層の上の部分ばかり語られがちではないでしょうか。まず、土台の「健康・安全」を堅固なものにしなければ、上へ伸ばしていくことはできません。

弊社は、子ども虐待対応を支援するAI搭載アプリ「AiCAN」を開発・提供しており(詳しくはこちら)、まさに「子どもの安全を守る」お手伝いをしています。子どもたちが健康かつ、安全・安心に生活でき、暴力・体罰を振るわれない土台をつくることで、未来を担う子どもたちの幸せへつなげていきたいと思っています。

・・・

いかがでしたか?盛りだくさんの内容から厳選して、ごくごく一部をご紹介しました。今回は弊社代表の発表を取り上げましたが、児童相談所の現役職員、子ども虐待やデータサイエンスの研究者、心理職志望の学生を教える大学教授など、登壇者は各分野の専門家が総勢8名。自宅にいながら、とても濃密な3時間を過ごすことができました。

本シンポジウムのアーカイブ動画が、主催・東京大学バリアフリー教育開発研究センターのWebサイトで公開されました。この記事を読んで興味が湧いた方は、ぜひご覧ください。

▼動画はこちらからご覧いただけます。

https://www.p.u-tokyo.ac.jp/cbfe/information/220828event/